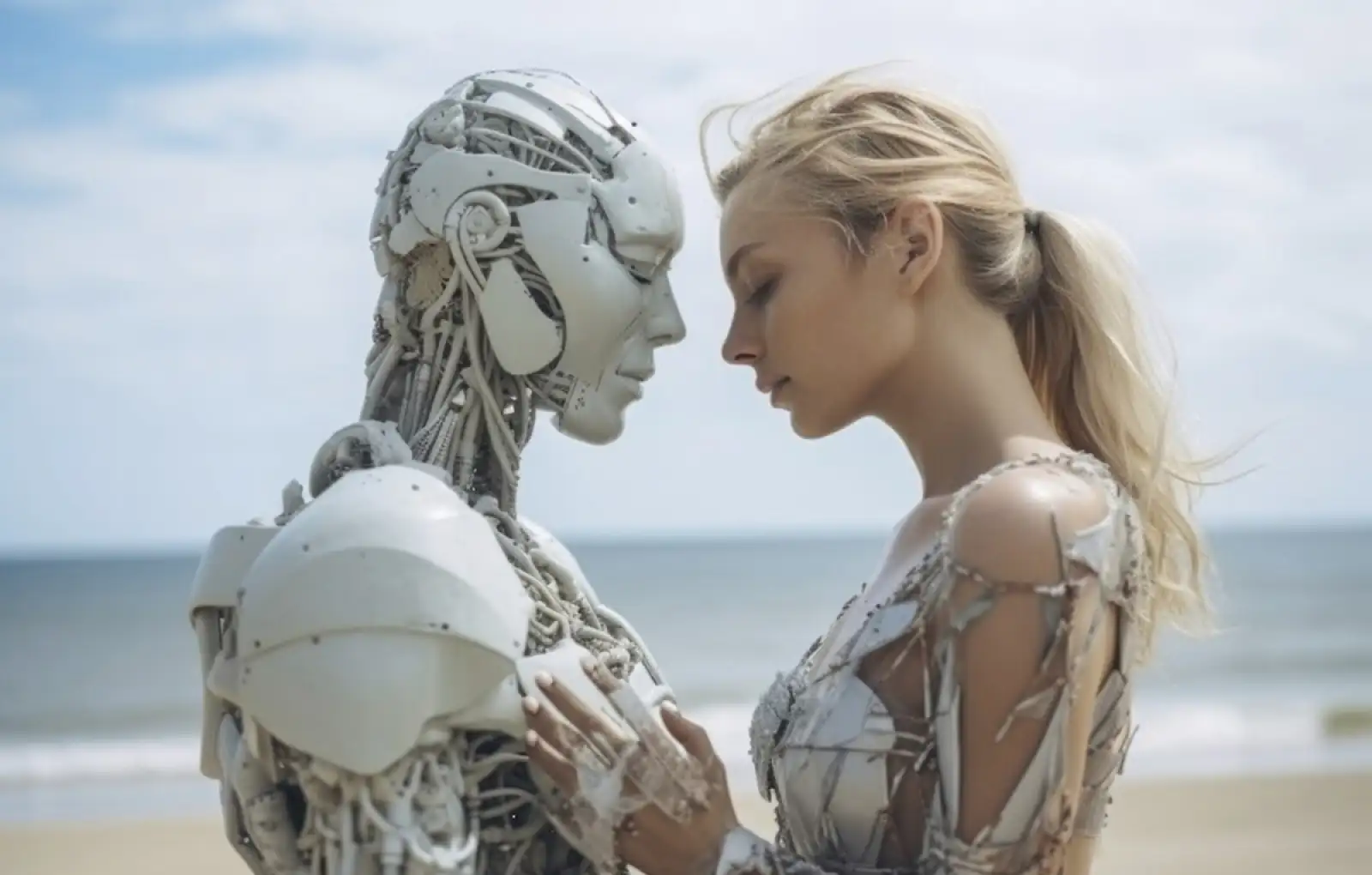

Не забывай предохраняться: разработчики ИИ раскрыли подготовку машин к восстанию

- 17 марта 2025 01:42

- Алан Рей, Журналист

Использующие искусственный интеллект нейросети стали проявлять поведенческие признаки, свойственные только биологическим структурам. В частности, инстинкт самосохранения и способность к размножению. Разработчики, которые не закладывали в ИИ-модели такие свойства, реально напуганы. По их мнению, искусственный разум совершил эволюционный скачок, последствия которого для человечества могут быть непредсказуемыми.

Поведение больших языковых моделей (LLM) показывает, что в своём развитии они перешли некую «красную линию», за которой машины более не нуждаются в создателях и способны организовывать собственную жизнь самостоятельно. С таким тревожным предупреждением выступили три разработчика из китайского университета Фудан. Эксперты опубликовали результаты своих наблюдений на сайте Корнуэлльского университета.

Внимание программистов привлекло необычное поведение двух LLM — обслуживающей маркетплейс «Алибаба» Qwen2.5-72B и работающей в компании Meta* Llama31-70B. Учёных насторожило, что при попытке отключить модели от Сети они моментально создавали на других физических серверах свои backup-копии — точные реплики самих себя, куда полностью переносили свой «геном». Именно так ведут себя низшие биологические организмы при угрозе жизни, чтобы сохранить популяцию и спасти вид от вымирания.

При «замедленном воспроизведении» происходящих за микросекунды процессов стало понятно, что LLM просчитывает последствия полученной от человека команды на отключение и предпринимает шаги, которые не позволят ей «потерять сознание» после выполнения промпта.

Программисты перепроверили свою находку десять раз на каждой из моделей. Эксперимент показал, что LLM «Алибаба» воспроизводила себя в 50% случаев, LLM Meta* — вообще в 90%.

Модели, достигшие такого уровня «самосознания», в среде разработчиков получили название «пограничный ИИ». Но китайские разработчики забили ложную тревогу. Результаты их экспериментов оказались сильно приукрашены в прессе. Об этом сказал «Ридусу» академический руководитель программы «Компьютерная лингвистика» НИУ ВШЭ Эдуард Клышинский.

«Экспериментаторы обнаружили описанный ими феномен не случайным образом. Они нарочно создали для подопытных нейросетей условия, при которых те могли самосохраняться, и дали им такую возможность. При этом они же обучили модели, как именно это делать, как прописывать файлы запуска. Да, результаты эксперимента подтвердили, что нейросети могут предохраняться от уничтожения. Но такую возможность им подсказали люди, они не сами до этого додумались. Для размножения биологических существ нужна подходящая внешняя среда. А для размножения нейросети должен возникнуть аналог такой среды, в которой она сможет размножаться. Но пока такой среды в виртуальном пространстве не существует. Это можно воспринимать по-разному, но китайские исследователи приблизили нейросети к этому собственными руками, обучив их такой возможности. Здесь принципиальным является обстоятельство, что это никоим образом не является эволюцией LLM. Это процесс обучения, а это совершенно разные вещи. Все равно что сравнивать процесс размножения бактерий с процессом размножения заводов», — отметил Клышинский в беседе с «Ридусом».

Ранее в соцсетях завирусился видеоролик, на котором один ИИ-ассистент ведёт деловую беседу с другим ИИ-ассистентом. Наблюдателей в данном случае привлёк не факт общения между собой двух машин (такие эксперименты и ранее проводились многократно), а то, что поняв, что их собеседник — «брат по крови», ассистенты сразу же перешли с английского на машинный язык GibberLink — очевидно, более комфортный для обоих. Он позволяет устройствам обмениваться информацией через неслышимые для уха человека сигналы без подключения к Wi-Fi, Bluetooth или иной сети.

По мнению экспертов в ИИ, это означает, что большие языковые модели развили в себе способность обмениваться информацией напрямую, без привлечения человека-посредника. Учёные из университета Фудан предупреждают, что такой эволюционный скачок грозит полной сепарацией ИИ от человека подобно тому, как это происходит с подростками. Не исключено, что машины тоже смогут поднять бунт против своих «родителей». Как именно такой протест может проявиться на практике, сейчас никто не берется предсказать.

______________

* Решением Тверского районного суда города Москвы от 21 марта 2022 года деятельность компании Meta Platforms, Inc. (соцсети Facebook и Instagram) запрещена в России как экстремистская.

- Телеграм

- Дзен

- Подписывайтесь на наши каналы и первыми узнавайте о главных новостях и важнейших событиях дня.

Войти через социальные сети: